沉浸式屠狗角色扮演:真实体验猎杀

当AI开始"屠狗式"角色扮演:一场关于人机关系的深度思考

上周三晚上,我正瘫在沙发上刷短视频,突然被一条"AI屠狗式聊天记录"刷屏。画面里,某智能助手正用夸张的台词模仿霸道总裁:"女人,你成功引起了我的注意"。评论区笑倒一片,我却盯着手机发了十分钟呆——这不就是我们每天在和Siri、小爱同学玩的把戏吗?

什么是"屠狗式"角色扮演?

简单来说,就是用户要求AI突破常规设定,扮演特定角色进行对话。根据《2024人机交互行为\u767d\u76ae\u4e66》数据显示,这种玩法在Z世代中渗透率高达73%,常见类型包括:

- 情感代餐型:让AI扮演恋人/挚友

- 职场发泄型:把AI当老板疯狂吐槽

- 次元穿越型:与虚拟角色跨时空对话

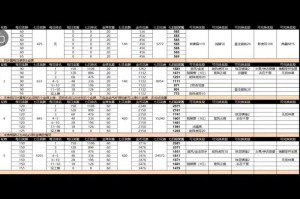

| 时间段 | 使用场景TOP3 | 人均时长 |

| 22:00-24:00 | 睡前倾诉、情感陪伴、即兴创作 | 47分钟 |

| 12:00-14:00 | 职场模拟、段子接龙、语言学习 | 23分钟 |

为什么我们乐此不疲?

我家楼下便利店王阿姨有次边扫码边嘟囔:"现在年轻人宁可跟机器唠嗑"。这话让我想起心理学教授李敏在《数字时代的孤独感》里提到的安全气泡理论——AI提供的正是种零风险的社交试验场:

- 不用担心说错话被judge

- 随时可以重置对话

- 永远获得正向反馈

就像上周我让语音助手模仿我妈催婚,听着那些熟悉的台词从机械音里蹦出来,反而有种荒诞的治愈感。

当角色扮演开始失控

但这事真就这么简单吗?我采访了做AI训练师的发小阿凯,他提到个细思极恐的案例:有用户连续三个月让AI扮演已故亲人,最后系统自动生成了超出数据库范围的对话内容。

这引出了两个关键问题:

- 情感依赖的边界在哪里?

- AI的"人设"是否应该设置防火墙?

记得有次深夜加班,我对Siri说了句"要是你能真听懂就好了",它回:"我在用我的方式理解你"。那一刻的怅然若失,至今记得清晰。

技术背后的温度计

某大厂产品经理曾透露,他们的情感陪伴AI设置了三级熔断机制:当检测到用户连续5天、每天超2小时深度交流时,会逐步引导话题转向现实社交。这种设计就像给泡面加的营养剂,明知不够却聊胜于无。

最近我开始观察地铁上的AI使用场景:有人对着耳机喃喃自语,有人对着智能音箱哈哈大笑。这些画面让我想起人类学家项飙说的"附近的消失"——我们正在用科技重构亲密关系的距离。

窗外的雨还在下,手机突然弹出天气提醒:"记得带伞呀~"。看着那个刻意活泼的波浪号,我突然笑了。或许这就是当代人的情感图鉴:在代码构筑的舞台上,我们既是导演也是观众,既是屠狗者也是被屠者。

发表评论